Tu souhaites en savoir plus sur la notion de matrice d’une application linéaire ? Améliore tes connaissances sur cette notion grâce à notre article dédié au chapitre : Définition et démonstration : matrice d’une application linéaire. Prochaine étape : réussis toutes tes interrogations écrites et orales sur la notion !

Et si tu veux franchir un nouveau palier dans ta préparation aux examens prends un cours de soutien scolaire d’algèbre. 🎓

Application linéaire canoniquement associée à une matrice

Définitions

Définition : Application linéaire canoniquement associé à une matrice

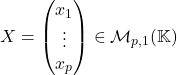

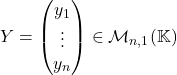

SoitRemarque : Matrice d’une application linéaire

Soit

On identifie

, et

, et  . Avec cette identification, l’application linéaire canoniquement associée à

. Avec cette identification, l’application linéaire canoniquement associée à

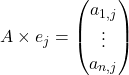

Définition : Noyau et image d’une matrice

SoientRemarques

On note

Pour tout

. Autrement dit,

. Autrement dit, On a alors :

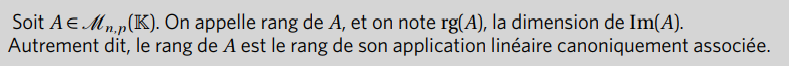

Définition : Rang d’une matrice

Remarque

SoientLes espaces vectoriels

Donc, par définition du rang de

Théorème

SoitOn a l’équivalence :

Démonstration

CommePar théorème,

De plus, comme

D’où, par définition du noyau, de l’image et du rang d’une matrice,

Remarque

SoitLe vecteur

Supposons que les coefficients

En transposant, on obtient un résultat similaire pour les matrices triangulaires inférieures.

Théorème

Soit

Démonstration

Soit

Proposition

On ne modifie pas le rang d’une matrice en la multipliant à droite ou à gauche par une matrice inversible.

Démonstration

SoientDe plus,

On traite de la même manière la multiplication à droite par une matrice inversible.

Corollaire

Soient

Démonstration

D’après la proposition précédentes, comme les matrices

Théorème

SoitDémonstration

On suppose qu’il existeOn considère

Or,

L’autre cas se traite de la même manière.

Proposition

Soit

Démonstration

On considèreOr, en dimension finie,

Donc, par définition du rang d’une matrice

Pour tout étudiant en quête d’une compréhension plus profonde, un cours particuliers de mathématiques peut éclairer la notion complexe de la matrice d’une application linéaire. 📘

Cet article est extrait de l’ouvrage Maths MPSI-MP2I. Tout-en-un : cours, méthodes, entraînement et corrigés (éditions Vuibert, juin 2021) écrit par E. Thomas, S. Bellec, G. Boutard. ISBN n°9782311408720

![Rendered by QuickLaTeX.com \[f : \begin{array}[t]{ccc} \mathbb{K}^p & \to & \mathbb{K}^n\\ (x_1,\dots,x_p) & \mapsto & \left(\underbrace{\sum\limits_{j=1}^pa_{1,j} x_j}_{y_1},\dots,\underbrace{\sum\limits_{j=1}^pa_{n,j} x_j}_{y_n}\right). \end{array}\]](https://sherpas.com/content/ql-cache/quicklatex.com-c0f118c2de2c819760fa8097cc35fd5b_l3.png)

![Rendered by QuickLaTeX.com \[(x_1,\dots,x_p) \in \mathrm{Ker}(A) \Longleftrightarrow A \begin{pmatrix} x_1\\\vdots\\x_p \end{pmatrix}=\begin{pmatrix} 0\\\vdots\\0 \end{pmatrix} \Longleftrightarrow \left\lbrace \begin{array}{cccccccc} a_{1,1} x_1 &+& \dots &+& a_{1,p} x_p&=&0\phantom{.}\\ \vdots&&&&\vdots&&\vdots\\ a_{n,1} x_1 &+& \dots &+& a_{n,p} x_p&=&0.\\ \end{array}\right.\]](https://sherpas.com/content/ql-cache/quicklatex.com-fa334f670cb6f023c7edc9041482d961_l3.png)

![Rendered by QuickLaTeX.com \[\left\lbrace\begin{array}{rcl} t_{1,1}x_1+t_{1,2}x_2+\dots +t_{2,n}x_n&=&0\\ t_{2,2}x_2+\dots +t_{1,n}x_n&=&0\\ \vdots\\ t_{n,n}x_n&=&0 \end{array}\right.\]](https://sherpas.com/content/ql-cache/quicklatex.com-dd90346d46f518962dc519d245a5f0bf_l3.png)

![Comment être fort en maths ? [Méthode]](https://sherpas.com/content/uploads/2021/10/woman-holding-books-3768126.jpg)