Pourquoi ton assistant IA hallucine-t-il parfois ? Pourquoi une voiture autonome a-t-elle du mal à comprendre une situation imprévue ? L’intelligence artificielle fait des merveilles, mais elle est encore loin de l’intelligence humaine : certaines limites technologiques freinent son développement. 🛑

Dans cet article, on explore les obstacles qui freinent le développement de l’IA et l’empêchent d’atteindre la flexibilité et l’adaptabilité de l’intelligence humaine. 🚀

🤔 Ce que l’IA ne sait pas (encore) faire

L’IA est souvent comparée à un « cerveau électronique », mais en réalité, elle ne réfléchit pas : elle analyse des modèles statistiques et traite d’immenses volumes de données sans véritable compréhension. Le fonctionnement du chatbot fait qu’il ne réfléchit pas, il calcule. Et cela pose plusieurs problèmes. 🤷

L’illusion de la compréhension

L’IA peut te donner des réponses très convaincantes, mais en réalité, elle ne comprend pas ce qu’elle dit.

💡 Si tu demandes à une IA de résumer un texte, elle va repérer les mots-clés et générer une version plus courte. Mais elle ne sait pas ce qui est important ni pourquoi. En fait, elle n’a pas de « bon sens » et ne fait que recopier des structures de phrases qu’elle a vues ailleurs.

À lire aussi

L’absence de raisonnement abstrait

L’IA a du mal avec les métaphores et la logique abstraite, parce qu’elle ne raisonne pas comme un humain. Elle détecte des schémas dans les données et établit des liens statistiques, mais sans réelle compréhension des concepts. Contrairement à un scientifique qui comprend les lois physiques derrière ce phénomène, l’IA applique des associations sans saisir les causes et les principes qui les gouvernent. 😅

💡 Par exemple, elle peut mémoriser que « l’eau bout à 100°C », mais si on change la pression atmosphérique dans le scénario, elle risque de se tromper.

Une rigidité face à l’imprévu

Si tu apprends une nouvelle règle dans un jeu, tu peux l’appliquer immédiatement. L’IA, elle, doit être entraînée sur un dataset gigantesque. Et encore, elle risque de faire des erreurs absurdes si elle rencontre une situation légèrement différente de ce qu’elle a vu. 😬

👉 Le problème ? Une IA ne généralise pas bien. Elle applique ce qu’elle a appris, mais dès que ça sort du cadre, elle est perdue.

💭 Pourquoi l’IA “hallucine” parfois ?

Si une IA “hallucine” en répondant à une question, c’est parce qu’elle ne « sait » pas si la réponse est correcte ou non. Elle assemble des mots avec des probabilités, mais elle ne vérifie pas ses propres dires. Résultat : elle peut affirmer une erreur avec autant d’assurance qu’une vérité. 🤥

À lire aussi

Ton premier cours particulier est offert ! 🎁

Nos profs sont passés par les meilleures écoles et universités.

🏗️ Pourquoi les modèles d’IA stagnent ?

L’intelligence artificielle repose sur des architectures complexes. Malgré leurs performances impressionnantes, ces systèmes sont rigides, coûteux et surtout, incapables d’évoluer véritablement sans intervention humaine. Alors, pourquoi les modèles actuels plafonnent-ils ?

Une dépendance totale aux données

Les IA modernes sont des gloutonnes de données. Elles n’apprennent pas comme toi, avec de l’expérience et des corrections progressives. Elles doivent absorber des quantités astronomiques d’informations pour fonctionner. Mais plus un modèle est grand, plus il a besoin de données, et les nouvelles données manquent parfois pour l’entraîner. 📊

👉 Conséquence ? Les IA finissent par « recycler » du contenu existant, ce qui limite leur capacité à innover.

🕵️ Test de poésie

Imagine que tu veuilles entraîner une IA à écrire des poèmes. Si elle a déjà vu tous les poèmes existants, elle ne peut que combiner ce qu’elle connaît. Elle ne pourra jamais inventer un style poétique totalement nouveau.

Une mémoire limitée et non persistante

Une autre faille majeure des IA actuelles, c’est qu’elles n’ont aucune mémoire de long terme. Par exemple, si tu discutes avec ChatGPT, il oublie tout ce que tu lui as dit dès que tu fermes la session. Résultat : impossible pour lui de vraiment « apprendre » sur le long terme ou de construire une relation avec toi. 🧠

💰 Certaines IA offrent des options payantes pour garder une mémoire partielle, mais ce n’est pas une vraie mémoire. Elles enregistrent seulement des résumés d’échanges pour ajuster leurs réponses, sans « se souvenir » vraiment.

👉 Conséquence ? Chaque fois qu’on veut une IA qui « se souvient« , on doit lui réinjecter manuellement des données ou utiliser des bases de mémoire externes.

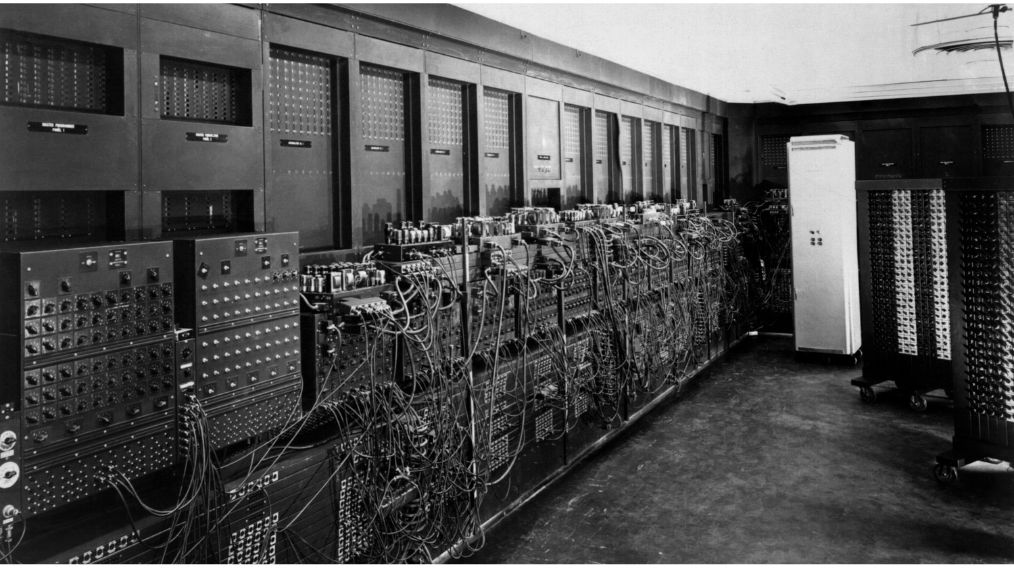

🛑 L’explosion des coûts et l’accès limité aux infrastructures

L’intelligence artificielle actuelle est une machine à cash. Derrière chaque modèle performant, il y a des milliers de GPU (puces informatiques), des centres de données énergivores et des investissements colossaux. Résultat ? Seuls quelques géants de la tech peuvent réellement développer et exploiter ces IA. Et ça, c’est un problème majeur pour l’innovation.

👀 Pourquoi c’est un souci ?

Quand seules quelques grandes entreprises contrôlent l’IA, l’innovation est freinée car les petits acteurs n’ont pas les moyens d’expérimenter et d’apporter de nouvelles idées. Moins de concurrence signifie aussi moins de diversité dans les approches et un développement orienté par les intérêts des géants de la tech.

Une IA, ça coûte une fortune

Former un modèle d’intelligence artificielle, c’est une bataille d’infrastructures. Les modèles comme GPT-4, Gemini ou Claude nécessitent des supercalculateurs massifs pour être entraînés. Ces infrastructures coûtent des millions d’euros pour être entraînés (et maintenus !).

💡 Par exemple, OpenAI aurait dépensé entre 41 et 78 millions d’euros en coûts techniques pour entraîner sa nouvelle version ChatGPT-4. Sans parler du coût du personnel, du stockage des données et de l’énergie consommée…

👉 Conséquence ? Seules quelques entreprises comme OpenAI, Google, Meta et Microsoft ont les moyens de financer ces entraînements. Les petits acteurs sont exclus de la compétition.

🌐 Déjà entendu parler du “Big Data” ?

Le Big Data désigne l’ensemble massif de données générées, collectées et analysées par les entreprises technologiques pour alimenter l’intelligence artificielle, personnaliser les services et optimiser la prise de décision.

Une consommation énergétique qui explose

L’IA ne se nourrit pas d’amour et d’eau fraîche. Chaque génération de modèle demande toujours plus d’énergie. ⚡

👉 Le problème ? Un modèle comme ChatGPT-4 consomme énormément d’électricité. L’empreinte carbone de l’IA devient donc un sujet préoccupant. Si elle continue à évoluer à ce rythme, son impact écologique pourrait devenir insoutenable.

💡 D’après une étude scientifique, l’augmentation de la consommation d’électricité des centres de données, des cryptomonnaies et de l’IA entre 2022 et 2026 pourrait être équivalente à la consommation d’électricité de la Suède ou de l’Allemagne.

Le monopole des puces 🖥️

L’IA repose sur une ressource clé : les puces graphiques (les Graphics Processing Unit, soit GPU). Ces puces, fabriquées en grande majorité par Nvidia, sont indispensables pour entraîner et faire tourner les modèles.

👉 Le problème ? Il y a un risque de pénurie de GPU. Nvidia contrôle une grande partie du marché et les prix explosent. Les entreprises qui n’ont pas accès à ces puces ne peuvent pas développer leurs propres IA. La dépendance aux grandes entreprises américaines crée un déséquilibre majeur.

Les autres limites de l’IA ⚠️

💾 Le vol de données de l’IA : certaines IA ne sont pas hyper clean… OpenAI et ses procès en cours en sont la preuve !

🌍 Impact environnemental de l’IA : faire tourner une IA, ça consomme un max d’énergie. Les data centers chauffent énormément, et une simple requête IA pompe plus qu’une recherche Google !

On en parle plus dans nos autres articles. 🖱️

Besoin de cours particuliers ? ✨

4 points de plus sur ta moyenne avec nos profs Sherpas ! 📈

🎯 Les pistes pour dépasser ces barrières technologiques

L’intelligence artificielle a encore de nombreux défis à surmonter, mais cela ne signifie pas que nous sommes bloqués. Les chercheurs explorent plusieurs pistes pour rendre l’IA plus fiable, plus flexible et moins coûteuse.

L’IA hybride : grouper l’intelligence humaine et artificielle

Plutôt que d’essayer de créer une IA 100 % autonome, certains experts pensent que le futur passe par une collaboration entre humains et IA. 🧠🤖

👉 L’idée ? Créer des modèles capables de travailler avec nous en tirant parti de notre raisonnement et de leur puissance de calcul. Plutôt que de demander à une IA de prendre seule des décisions critiques, on pourrait l’utiliser comme un assistant hyper performant, capable d’expliquer ses choix et de corriger ses propres erreurs.

💡 En médecine, une IA pourrait proposer plusieurs hypothèses de diagnostic, mais ce serait toujours un médecin qui validerait la décision finale. Les usages innovants de l’IA existent dans différents secteurs.

Des modèles plus efficaces, inspirés par cerveau humain

Les modèles actuels sont des monstres de calcul, mais leur fonctionnement est loin d’être optimal. Pour résoudre cela, plusieurs pistes sont possibles. ⚙️

- Les réseaux de neurones bio-inspirés : des modèles qui fonctionnent plus comme le cerveau humain, avec des connexions dynamiques et adaptatives.

- L’IA frugale : au lieu d’entraîner des modèles gigantesques, on cherche à développer des IA capables d’apprendre avec peu de données.

- Les mémoires persistantes : donner aux IA la capacité de se souvenir de leurs interactions passées et d’apprendre progressivement.

Un accès plus équitable aux infrastructures d’IA

Aujourd’hui, l’IA est dominée par quelques grandes entreprises qui ont les moyens d’entraîner des modèles super puissants. Mais plusieurs initiatives cherchent à rendre l’IA plus accessible :

- Les modèles open-source : des plateformes comme Hugging Face veulent proposer des modèles au code utilisable par tout le monde. 🌍

- Les puces spécialisées : au lieu d’utiliser des GPU très chers, des chercheurs développent des processeurs optimisés, plus économiques et écologiques (affaire à suivre !).

- Les régulations pour limiter les monopoles : certains gouvernements mettent en place des règles pour éviter que l’IA ne soit contrôlée par une poignée d’entreprises.

💡 Tu as peut-être entendu de Mistral AI, une startup française qui a récemment créé une alternative européenne à ChatGPT, plus ouverte et accessible.

Une IA plus éthique et responsable

L’IA ne pourra pas évoluer sans prendre en compte des règles strictes pour éviter les dérives.

⚖️ Les grands axes de travail :

- Des algorithmes plus transparents, pour que l’IA puisse expliquer ses décisions.

- Un encadrement juridique, pour éviter les biais et la discrimination algorithmique.

- Un meilleur contrôle de l’énergie consommée, pour limiter l’impact écologique de l’IA.

🔮 Alors, l’IA sera-t-elle un jour « parfaite » ?

Soyons réalistes : une intelligence artificielle vraiment comparable à l’humain, capable de comprendre, raisonner et s’adapter de manière autonome, ce n’est pas pour demain. Mais les innovations en cours nous rapprochent d’un futur où l’IA sera plus fiable, plus accessible et moins énergivore.

En attendant, il est essentiel de ne pas surestimer ses capacités et de comprendre ses limites. L’IA est un outil puissant, mais elle reste dépendante de ce que nous lui apportons.

On espère que cet article t’a plu. N’hésite pas à prendre un cours particulier chez les Sherpas pour aller plus loin dans ton apprentissage ! 🚀