Tu t’es déjà demandé comment l’intelligence artificielle a été inventée ? C’est plutôt fou qu’on est passé de vieux ordis à des machines capables d’écrire des textes, de battre les meilleurs joueurs d’échecs et même de créer des images ! 🤖

L’histoire de l’IA, c’est une aventure faite de découvertes révolutionnaires. Dans cet article, on va remonter le fil du temps pour explorer ses débuts et comprendre son évolution jusqu’aux IA d’aujourd’hui. 🚀

Les débuts de l’IA (1943-1960)

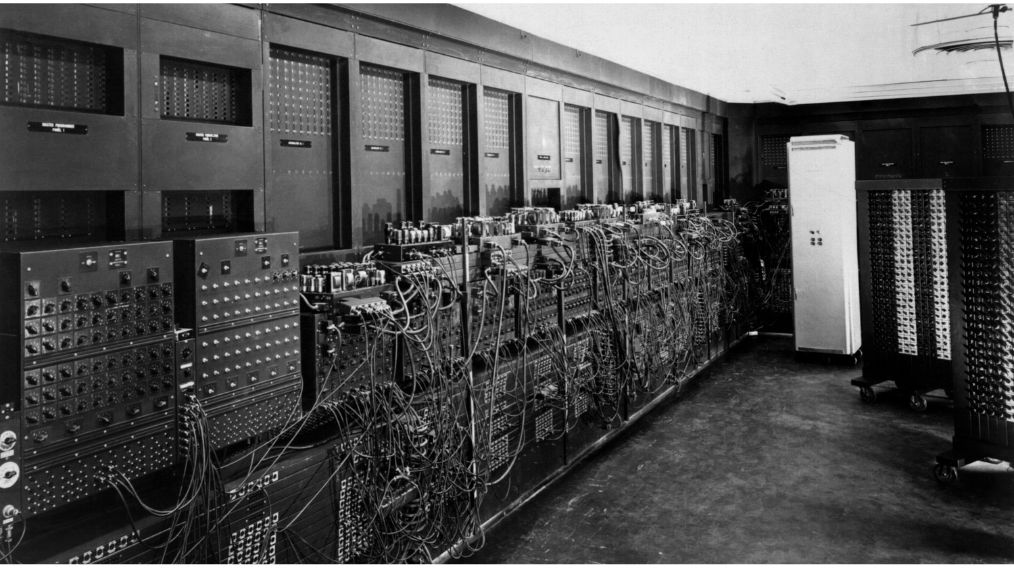

L’idée que des machines puissent penser ne date pas d’hier. Mais il a fallu attendre le XXe siècle pour que des scientifiques s’y attaquent sérieusement (et surtout, qu’ils disposent de la technologie nécessaire).

Les premiers modèles de neurones artificiels (1943) 🏗️

Tout commence en 1943 avec Warren McCulloch et Walter Pitts, deux chercheurs qui imaginent un modèle mathématique de neurones artificiels. Leur approche reste théorique : ils ne construisent pas de machine, mais posent les bases d’un système capable de traiter l’information comme un cerveau, avec des neurones interconnectés qui s’activent ou non selon certaines règles logiques.

C’est une avancée énorme ! Même si leur modèle est très simpliste, il développe les bases des futurs réseaux neuronaux qui dominent l’IA aujourd’hui.

Alan Turing et le test de l’intelligence (1950) 🤖

Difficile de parler des débuts de l’IA sans évoquer Alan Turing. Ce génie britannique, connu pour avoir cassé le code Enigma pendant la Seconde Guerre mondiale, pose une question provocante en 1950 : « Une machine peut-elle penser ? »

Il propose un test, qu’on appelle aujourd’hui le test de Turing. Le principe est simple : si une machine peut tenir une conversation indiscernable de celle d’un humain, alors elle peut être considérée comme « intelligente ».

Ce test reste encore aujourd’hui une référence dans le débat sur l’intelligence des machines.

Turing a posé les bases de l’informatique moderne et de la réflexion sur l’intelligence artificielle. Sans lui, il n’y aurait probablement pas d’IA moderne.

Si le sujet t’intéresse, on te conseille de regarder le film Imitation Game (2014). Il raconte l’histoire du décryptage du code Enigma et comment Turing a joué un rôle clé dans la défaite des nazis.

La conférence de Dartmouth (1956) 🎉

En 1956, une petite révolution se produit à Dartmouth College, aux États-Unis. Un groupe de chercheurs, mené par John McCarthy et Marvin Minsky, organise une conférence où ils introduisent officiellement le terme “intelligence artificielle”.

Leur ambition : construire des machines capables de simuler la pensée humaine. Ils sont persuadés que, dans quelques années, l’IA surpassera les humains dans de nombreuses tâches.Bon, ils ont été un peu trop optimistes. 😅 Mais cette conférence marque le début officiel de la discipline. L’IA est née !

À lire aussi

Ton premier cours particulier est offert ! 🎁

Nos profs sont passés par les meilleures écoles et universités.

Les années 60-80 : une période d’expérimentation 🔍

Les chercheurs de l’IA veulent transformer leurs idées en réalité et se mettent à expérimenter. Mais si certaines avancées sont impressionnantes, elles révèlent aussi les limites des approches utilisées…

L’IA symbolique et les premiers algorithmes heuristiques (années 60) 🏛️

Dans les années 60, l’IA repose sur une idée simple : pour qu’une machine réfléchisse, il faut qu’elle manipule des symboles et des règles logiques, comme un humain le ferait.

C’est ce qu’on appelle l’IA symbolique. On crée alors des algorithmes capables de résoudre des problèmes complexes en suivant des instructions précises.

Un exemple marquant

Le programme Logic Theorist (1956), développé par Allen Newell et Herbert Simon. Ce logiciel était capable de démontrer des théorèmes mathématiques, et parfois même de trouver des preuves plus élégantes que celles des humains !

Mais il y a un hic : ces IA fonctionnent bien pour des problèmes très encadrés, mais dès qu’on leur donne une tâche plus vague, elles se retrouvent bloquées. Il reste encore beaucoup de travail à faire pour la rapprocher de l’IA d’aujourd’hui.

L’âge d’or des systèmes experts (1970-1980) 🧠

Face aux limites des algorithmes symboliques, les chercheurs se tournent vers une nouvelle approche : les systèmes experts. Plutôt que de tout calculer, une IA peut imiter les experts humains en s’appuyant sur une base de connaissances et un moteur d’inférence.

Les premiers systèmes experts font sensation. MYCIN, par exemple, développé dans les années 70, était un programme capable de diagnostiquer des infections sanguines et de recommander des traitements. C’est révolutionnaire !

Cependant, cette période d’enthousiasme cache déjà les premiers signes de difficultés. À partir de 1974, un « hiver de l’IA » commence à se dessiner. Plusieurs rapports critiques, notamment celui de James Lighthill, montrent un manque de progrès concrets dans des domaines comme la robotique. Malgré des avancées intéressantes, l’IA n’a pas encore atteint les objectifs ambitieux fixés au début. Cela commence à freiner les financements et l’enthousiasme autour des projets.

Les limites et le deuxième hiver de l’IA (années 80) ❄️

Les années 80 ont des problèmes similaires à la fin des années 70 :

- Coûts trop élevés : la création et la maintenance des systèmes d’IA sont très chères.

- Manque de flexibilité : les systèmes ne sont pas capables de s’adapter à des situations nouvelles.

- Technologie limitée : les ordinateurs de l’époque ne peuvent pas gérer des systèmes aussi complexes.

Résultat : les investisseurs se lassent, les financements s’effondrent et l’IA entre dans ce qu’on appelle un deuxième “hiver de l’IA”. Pendant près d’une décennie, les avancées ralentissent et l’intérêt pour l’IA diminue.

Besoin de cours particuliers ? ✨

4 points de plus sur ta moyenne avec nos profs Sherpas ! 📈

Les années 90-2000 : le retour de l’IA grâce à l’apprentissage machine 🔄

Une nouvelle approche va tout changer : l’apprentissage machine (machine learning).

Le machine learning permet à une machine d’apprendre à partir de données et d’améliorer ses performances sans être programmée pour chaque tâche spécifique.

L’échec du paradigme symbolique et la montée du machine learning 📈

Dans les années 90, on réalise que l’approche symbolique et les systèmes experts ont atteint leurs limites. Ils sont rigides, incapables de traiter des situations inconnues et demandent une maintenance lourde.

Heureusement, une autre voie commence à s’imposer : celle de l’apprentissage statistique.

L’idée clé du machine learning

Une IA peut apprendre à reconnaître des motifs et à prendre des décisions en analysant de grandes quantités de données. Plus elle voit d’exemples, plus elle s’améliore.

Ce changement est en grande partie dû aux progrès dans trois domaines :

✔️ La puissance de calcul : les ordinateurs deviennent plus performants et moins chers.

✔️ L’accès aux données : Internet explose et génère une masse d’informations exploitable.

✔️ De nouveaux algorithmes : des modèles comme les réseaux de neurones refont surface.

Victoire d’IBM Deep Blue contre Kasparov (1997) ♟️

En 1997, un événement va marquer les esprits : l’ordinateur Deep Blue, développé par IBM, bat Garry Kasparov, champion du monde d’échecs.

C’est la première fois qu’une machine surpasse un humain dans un jeu aussi stratégique. Mais attention, Deep Blue n’est pas une IA « intelligente » au sens propre : il ne fait que calculer des millions de coups à l’avance.

Néanmoins, cette victoire montre le potentiel immense des nouvelles approches et donne un coup de projecteur sur l’IA.

Les bases du deep learning posées par Geoffrey Hinton 🧠

Dans les années 2000, un chercheur va jouer un rôle clé dans la renaissance de l’IA : Geoffrey Hinton. Il travaille sur un concept abandonné depuis les années 60 : les réseaux de neurones artificiels. Grâce aux avancées en calcul et en données, il est enfin possible d’entraîner des réseaux profonds, capables d’apprendre à détecter des motifs sans intervention humaine.

Depuis 2010 : l’ère du deep learning et des modèles de langage 🤖

Si les années 90 et 2000 ont préparé le terrain, c’est dans les années 2010 que l’IA explose véritablement. Grâce au deep learning et aux gigantesques bases de données d’Internet, les machines atteignent des niveaux de performance jamais vus.

Le deep learning est une branche du machine learning qui utilise des réseaux de neurones complexes pour apprendre des données et résoudre des tâches comme la reconnaissance d’images ou le traitement du langage.

Pourquoi le deep learning change tout ? 🔥

En 2012, l’équipe de Geoffrey Hinton participe à un concours mondial de reconnaissance d’images, ImageNet, et pulvérise les records grâce à un modèle de deep learning.

Pour la première fois, une IA surpasse les humains dans la classification d’images. Les entreprises technologiques (Google, Facebook, Microsoft…) se ruent sur cette technologie et investissent massivement.

En quelques années :

✔️ Les assistants vocaux comme Siri, Alexa et Google Assistant deviennent bien plus efficaces.

✔️ Les IA de reconnaissance faciale et de traduction automatique (DeepL, Google Translate) deviennent performantes.

✔️ Les voitures autonomes commencent à devenir une réalité grâce à l’analyse en temps réel des données visuelles.

Le deep learning marque une rupture : on ne programme plus une IA pour résoudre un problème, on lui donne des tonnes de données et elle apprend toute seule.

AlphaGo (2016) : la claque pour les humains 🏆

Si Deep Blue avait impressionné en battant Kasparov en 1997, un autre exploit va bouleverser le monde : AlphaGo.

En 2016, ce programme conçu par DeepMind (Google) bat Lee Sedol, l’un des meilleurs joueurs de Go de l’histoire.

C’est plutôt incroyable, car le jeu de Go est infiniment plus complexe que les échecs. Il ne peut pas être résolu par simple calcul. Pourtant, AlphaGo apprend à jouer en analysant des milliers de parties et en s’entraînant contre lui-même.

À partir de là, plus personne ne doute : l’IA est en train de dépasser l’homme dans des tâches que l’on croyait réservées aux humains.

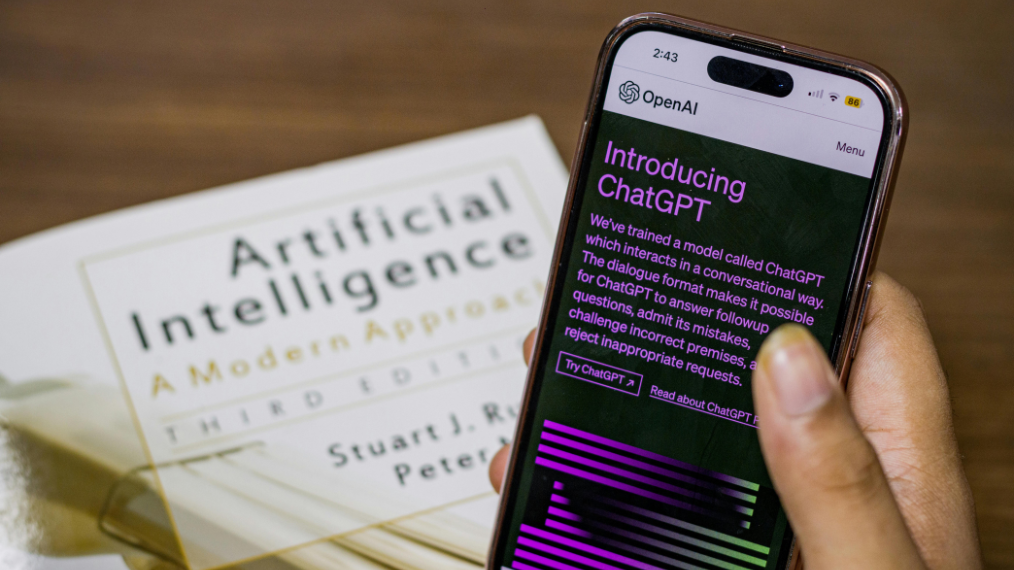

Les modèles de langage et l’explosion des IA génératives ✍️

L’une des plus grandes avancées récentes, c’est l’arrivée des modèles de langage comme GPT-3 (2020) et GPT-4 (2023).

Ces IA sont capables de rédiger des textes, coder, traduire, répondre à des questions complexes, et même tenir des conversations naturelles avec nous. Elles sont entraînées sur des milliards de phrases extraites du Web et utilisent des mécanismes sophistiqués pour prédire le mot suivant dans une phrase.

L’impact sur le travail est déjà énorme, avec des tâches comme la rédaction ou l’assistance à la programmation qui se font en temps réel.

À lire aussi

Conclusion 🚀

En l’espace de quelques décennies, l’intelligence artificielle est passée de théories abstraites à des outils concrets qui transforment nos vies. Nos autres articles répondent à plusieurs questions :

💡 L’IA remplacera-t-elle certains métiers ?

💡 Faut-il la réguler pour raison de vol de données ?

💡 Quel est son impact environnemental ?

💡Quelles sont ses limites actuelles ?

Les prochaines années s’annoncent passionnantes, et peut-être un peu vertigineuses. Une chose est sûre : l’IA ne fait que commencer à écrire son histoire.

Pour aller plus loin : prends un cours particulier avec l’un de nos profs Sherpas !